Le 5 février, le secteur de l'IA a connu une « collision » historique avec le lancement par Anthropic et OpenAI de leurs modèles phares.Claude Opus 4.6 et Codex GPT-5.3—dos à dos.

Face à des lancements simultanés aussi médiatisés, il est essentiel, pour départager les deux produits, de dépasser le simple effet de mode et de se concentrer sur des critères techniques objectifs. Mon analyse se divise généralement en trois volets : les principales mises à jour techniques, les enseignements tirés des benchmarks quant à leurs capacités, et les différences de déploiement en situation réelle. J’utiliserai ci-dessous ce cadre d’analyse pour décortiquer les caractéristiques techniques et les performances empiriques de ces deux modèles.

Analyse des percées dans l'opus 4.6 de Claude

D'après mon recherches antérieures et les dernières nouvelles documentation technique, l'évolution de Claude Opus 4.6 se concentre sur plusieurs innovations architecturales révolutionnaires :

- Pensée adaptative : Cette fonctionnalité permet au modèle d'allouer dynamiquement les ressources de calcul en fonction de la difficulté de la tâche. Lors de mes tests, j'ai constaté que le modèle répond quasi instantanément aux requêtes simples, tandis qu'il passe en mode de « raisonnement approfondi » pour les conceptions architecturales complexes, prenant davantage de temps pour garantir la rigueur logique.

- Contexte et compactage d'un million de jetons API: Bien que la fenêtre d'un million de jetons soit énorme, la véritable innovation réside dans API de compactagePour contrer la baisse de performance typique des conversations longues, cette API compresse intelligemment l'historique des dialogues en ne conservant que les nœuds logiques essentiels. Cela réduit considérablement les coûts d'inférence pour les projets de longue durée.

- Contrôles de résidence des données : Cette version permet aux entreprises de limiter l'analyse des données aux serveurs situés aux États-Unis. J'y vois une initiative stratégique visant à répondre aux exigences de conformité strictes des secteurs réglementés comme la finance et la santé.

- Longueur de sortie 128K : La capacité de production maximale par tour a été étendue à 128 000 jetons, permettant au modèle de générer des blocs de code massifs ou des documents techniques entiers en une seule opération sans perte de cohérence.

Décryptage des forces agentiques de GPT-5.3-Codex

OpenAI Codex GPT-5.3 Il privilégie la vitesse d'exécution et l'interaction au niveau système. D'après les spécifications officielles, ses principaux atouts sont les suivants :

- Amélioration de l'efficacité de l'inférence : Ce modèle est 25% plus rapide que son prédécesseur, GPT-5.2 Codex. Lors de mes tests comparatifs, GPT-5.3 Codex a démontré un débit nettement supérieur pour des tâches de génération de scripts identiques.

- Direction en milieu de virage : Cela permet aux utilisateurs d'émettre de nouvelles instructions pendant l'exécution d'une tâche de longue durée par le modèle. Par exemple, si le modèle exécute un script automatisé dans le terminal, je peux intervenir et corriger son déroulement en temps réel sans redémarrer le processus.

- Capacité opérationnelle au niveau du système : Présenté comme un « modèle de programmation agentielle », il va au-delà de la simple écriture de code. Il a été optimisé pour utiliser des outils au niveau du système d'exploitation, gérer les déploiements et surveiller les environnements de test de manière autonome.

- Développement auto-assisté : OpenAI a révélé que GPT-5.3 Codex a été utilisé lors de ses phases d'entraînement et de débogage. Cela indique que le modèle a atteint un niveau de maturité technique lui permettant de contribuer à son propre développement.

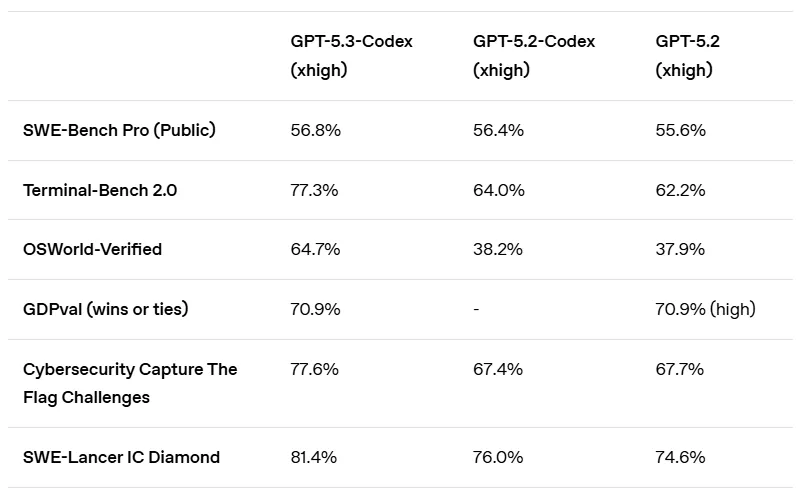

Comparaison des performances : Claude Opus 4.6 vs. GPT-5.3-Codex

Pour mesurer objectivement les performances, j'ai sélectionné plusieurs indicateurs de référence conformes aux normes du secteur. Voici une brève explication de ce que représentent ces indicateurs :

- Terminal-Bench 2.0 : Évalue la capacité de l'IA à exécuter des commandes complexes et à gérer des tâches au sein d'une interface de ligne de commande (CLI).

- SWE-bench Pro : Mesure le taux de réussite de l'IA dans la résolution de problèmes concrets d'ingénierie logicielle, tels que les corrections de bogues réelles sur GitHub.

- GDPval-AA : Évalue la maîtrise du modèle dans les tâches professionnelles à forte valeur ajoutée, telles que l'analyse financière et la recherche juridique.

- OSWorld : Teste la capacité de l'IA à naviguer dans une interface utilisateur graphique (GUI) pour accomplir les tâches de bureau quotidiennes.

- Le dernier examen de l'humanité : Un test de raisonnement multidisciplinaire de haute difficulté, conçu pour repousser les limites des connaissances de niveau expert.

| Métrique | Claude Opus 4.6 | Codex GPT-5.3 | Qui gagne ? |

| Terminal-Bench 2.0 | 65.40% | 77.30% | Codex GPT-5.3 |

| SWE-bench Pro | Non divulgué | 57.00% | Codex GPT-5.3 |

| OSWorld | 46.20% | 64.70% | Codex GPT-5.3 |

| PIBval-AA (Elo) | +144 par rapport à la ligne de base | Ligne de base | Claude Opus 4.6 |

| Le dernier examen de l'humanité | Meilleur score | Non divulgué | Claude Opus 4.6 |

| Fenêtre contextuelle | 1 000 000 de jetons | ~200 000 jetons | Claude Opus 4.6 |

| Amélioration de la vitesse | Ligne de base | 0.25 | Codex GPT-5.3 |

Analyse de scénarios réels : quel modèle choisir ?

En fonction des paramètres techniques et des données ci-dessus, je recommande ce qui suit pour différents besoins professionnels :

Choisissez Claude Opus 4.6 si :

- Vous êtes architecte logiciel : C'est le choix idéal pour la refonte de projets existants comportant des centaines de milliers de lignes de code.

- Vous travaillez dans des secteurs à forte conformité : Elle est plus performante dans le domaine de la finance ou du droit, où la précision logique et le respect des réglementations sont non négociables.

- Vous avez une tolérance zéro pour les « hallucinations » : Lors des derniers tests « Aiguille dans une botte de foin », son rappel en contexte long a atteint 76%, surpassant largement ses concurrents.

Choisissez le codex GPT-5.3 si :

- Vous êtes un développeur Full-Stack : Il est optimisé pour une vitesse de développement maximale et pour les tâches nécessitant une interaction fréquente avec les terminaux, les bases de données et les plateformes cloud.

- Vous préférez la programmation « avec intervention humaine » : La direction en milieu de virage est idéale pour les développeurs qui souhaitent ajuster le flux logique de l'IA par le biais d'un dialogue continu.

- Vous êtes spécialisé en cybersécurité : Premier modèle classé avec la mention « Capacité de cybersécurité de haut niveau », il possède un avantage décisif en matière de détection et de défense contre les vulnérabilités.

Ma conclusion concernant cette sortie simultanée est que les deux entreprises se sont orientées vers « l'exécution de tâches de longue durée » et « l'ingénierie agentielle », bien qu'avec des objectifs différents. Claude Opus 4.6 excelle dans les contextes ultra-longs, la gestion de sessions (compaction) et la conformité d'entreprise. À l'inverse, Codex GPT-5.3 domine les benchmarks d'ingénierie logicielle, la vitesse d'exécution et l'utilisation des outils à long terme.

Pour la sélection au niveau de l'équipe, je suggère une règle simple : effectuez un test A/B en utilisant vos propres référentiels internes. Suivez le taux de réussite, le nombre de révisions, le coût et le délai de livraison plutôt que de vous fier uniquement à des benchmarks externes.

Pour les particuliers, s'abonner aux deux services peut s'avérer prohibitif. Dans ce cas, je recommande d'utiliser un agrégateur comme iWeaverIl vous permet d'accéder aux deux modèles avec un seul abonnement, ce qui vous permet de passer instantanément de Claude à GPT jusqu'à trouver celui qui convient parfaitement à votre tâche spécifique.