Am 7. Januar 2026 hat OpenAI offiziell eine mit Spannung erwartete Erweiterung seines Ökosystems eingeführt: ChatGPT GesundheitDiese unabhängige Schnittstelle, die in ChatGPT integriert ist, soll Nutzern helfen, persönliche Gesundheitsdaten zu aggregieren, komplexe medizinische Informationen zu interpretieren und sich effektiv auf klinische Konsultationen vorzubereiten.

Für Branchenbeobachter stellt diese Produkteinführung mehr als nur ein Funktionsupdate dar; sie markiert einen entscheidenden Wendepunkt in der KI-Entwicklung – vom „Allzweckassistenten“ zum „Experten für vertikale Domänen“. Diese Analyse beleuchtet die Kernfunktionen von ChatGPT Health, die Datenschutzprotokolle und die Auswirkungen auf das persönliche Gesundheitsmanagement.

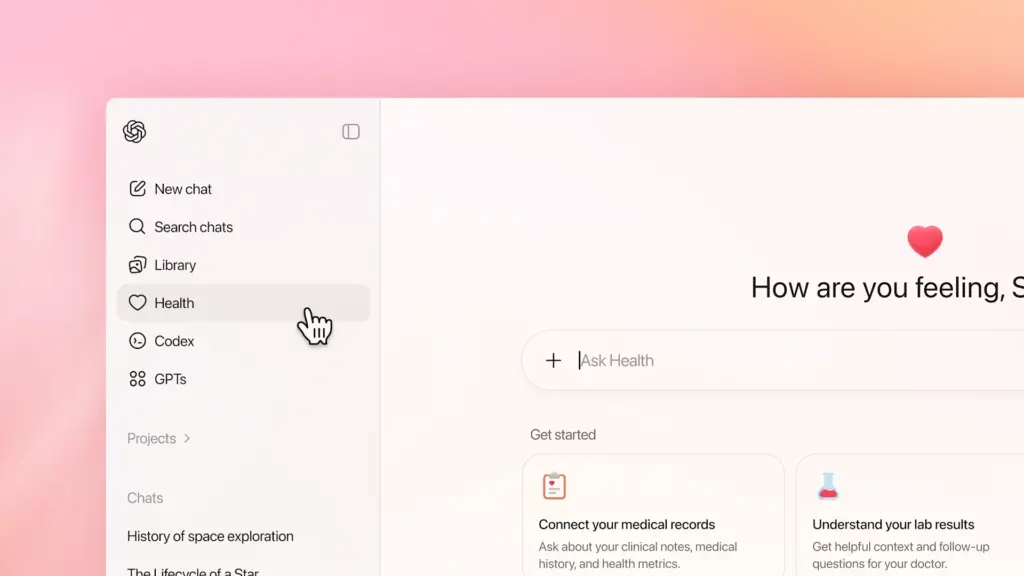

Was ist ChatGPT Health?

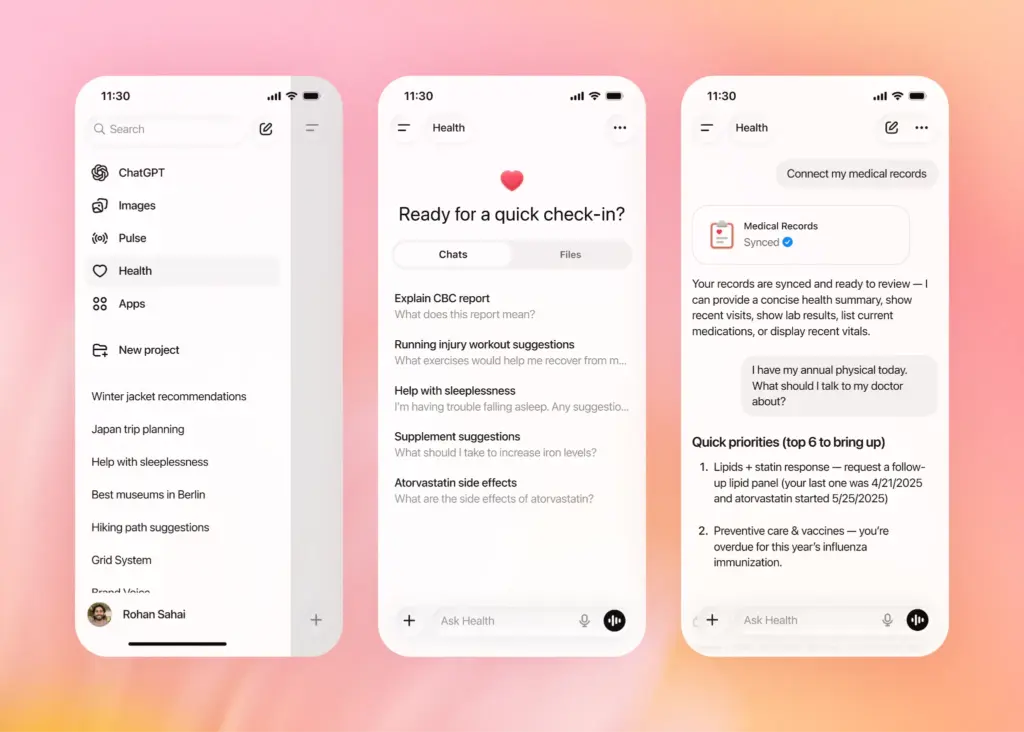

ChatGPT Health ist eine spezielle, verschlüsselte Umgebung innerhalb der OpenAI-Oberfläche, die speziell für Anfragen zu Gesundheit und Wohlbefinden entwickelt wurde. Ihr Hauptziel ist es, Nutzer bei der Organisation, dem Verständnis und der Verfolgung komplexer Gesundheitsdaten zu unterstützen.

Im Gegensatz zum Standard-ChatGPT-Modell wurde die Health-Schnittstelle speziell auf medizinische Standards und Fachterminologie abgestimmt. Entscheidend ist, dass sie die direkte Integration mit Gesundheitsanwendungen von Drittanbietern unterstützt (wie z. B. …). Apple Health, MyFitnessPal, Und Oura) und elektronischen Patientenakten (EHR). Dies ermöglicht es der KI, personalisierte Analysen auf der Grundlage realer physiologischer Daten anstelle allgemeiner medizinischer Ratschläge bereitzustellen.

Hauptmerkmale: Was kann es leisten?

- Datenintegration aus mehreren Quellen: Durch den Abbau von Datensilos aggregiert ChatGPT Health Kennzahlen wie Schrittzahl, Schlafqualität und Ernährungsprotokolle. Diese Daten werden miteinander verknüpft, um ganzheitliche Gesundheitstrends zu identifizieren.

- Analyse medizinischer Dokumente: Nutzer können PDFs oder Bilder von Laborberichten und Blutwerten hochladen. Die KI extrahiert die wichtigsten Indikatoren und erklärt die Ergebnisse in verständlichem Deutsch.

- Vorbereitung vor dem Termin: Auf Grundlage der gemeldeten Symptome und der Krankengeschichte generiert das System einen „Leitfaden für das Arztgespräch“, der Patienten dabei hilft, ihre Fragen zu priorisieren, um die begrenzte persönliche Gesprächszeit mit den Ärzten optimal zu nutzen.

- Langfristige Trendverfolgung: Über die Momentaufnahme hinaus überwacht die KI physiologische Veränderungen im Längsschnitt, um potenzielle Risiken frühzeitig zu erkennen.

Eine Fallstudie aus der Praxis: Von Verwirrung zu Präzision

Millionen von Nutzern weltweit wenden sich bereits bei Gesundheitsfragen an KI. Um die Leistungsfähigkeit des neuen Spezialmodells zu testen, habe ich meine aktuellen Ergebnisse der jährlichen Vorsorgeuntersuchung in das System hochgeladen.

Das Erlebnis:

„Ich habe einen Blutbefund mit Dutzenden biochemischen Markern hochgeladen. ChatGPT Health hat die Daten sofort analysiert und Störfaktoren herausgefiltert. Es bestätigte, dass wichtige Werte wie die Anzahl der weißen Blutkörperchen im Normbereich lagen. Allerdings wurde festgestellt, dass meine Hämoglobin- und Ferritinwerte grenzwertig niedrig waren. In Verbindung mit den zuvor dokumentierten Müdigkeitssymptomen deutete dies auf ein mögliches Risiko einer Eisenmangelanämie hin.“

Klinischer Nutzen:

Die KI begnügte sich nicht damit, das Problem zu identifizieren. Sie lieferte klinischen Kontext, schlug konkrete Ernährungsumstellungen vor und skizzierte Folgeuntersuchungen, die mit einem Arzt besprochen werden sollten.

ChatGPT Health ermöglichte es mir als Laie, einen komplexen medizinischen Bericht zu verstehen. Beim anschließenden Arztbesuch wandelte sich die Dynamik vom passiven Zuhören hin zur aktiven Beteiligung. Ich konnte auf bestimmte Punkte hinweisen und gezielte Fragen stellen, wodurch ich den größtmöglichen Nutzen aus der kurzen Konsultation zog.

Die Kontroverse: KI-Halluzinationen und Datenschutzbedenken

Trotz ihres Nutzens wirft die Integration von KI in das Gesundheitswesen berechtigte Bedenken auf. Halluzinationen Und Datensicherheit.

- Das Risiko von KI-Halluzinationen: Erste Nutzerrückmeldungen deuten darauf hin, dass KI gelegentlich leichte Symptome fälschlicherweise als Anzeichen schwerwiegender Erkrankungen interpretiert. Bei Nutzern ohne medizinische Ausbildung kann diese „Überdiagnose“ unnötige Panik und Gesundheitsängste auslösen.

- Datenschutz & Versicherung: Eine weit verbreitete Sorge betrifft die mögliche Monetarisierung sensibler Daten. Nutzer befürchten, dass hochgeladene Gesundheitsdaten an Versicherer verkauft werden könnten, was unter Umständen zu Ablehnungen von Leistungsanträgen oder Prämienerhöhungen führen könnte.

So nutzen Sie ChatGPT Health sicher: Ein strategischer Leitfaden

Um diese Risiken zu minimieren, müssen Nutzer klare Grenzen festlegen. Hier sind drei Strategien für eine sichere Nutzung:

Die „Co-Pilot“-Mentalität

Betrachten Sie ChatGPT Health stets als Nachschlagewerk, nicht als Diagnoseinstrument. Es ist ein „Co-Pilot“, nicht der Pilot. Alle Entscheidungen bezüglich Behandlungsplänen oder Medikamenten müssen von einem approbierten Arzt bestätigt werden.

- Hinweis zur psychischen Gesundheit: Obwohl die KI als unterstützender Zuhörer dienen kann, ist bei der Empfehlung von Medikamenten gegen psychische Erkrankungen äußerste Vorsicht geboten.

Vertrauen ist gut, Kontrolle ist besser: Die Datenschutzverpflichtungen von OpenAI

OpenAI hat für diese spezielle Funktion strenge Datenrichtlinien implementiert. Hilfezentrum bietet Antworten auf Sicherheitsfragen, einschließlich Datensicherheit, Zugriff durch Dritte und wie man die Nutzung der App beendet oder sie löscht, falls Probleme auftreten:

- Kein Modelltraining: OpenAI gibt an, dass Konversationen, Dateien und Erinnerungen innerhalb des Health-Arbeitsbereichs ausgeschlossen aus dem standardmäßigen Training zukünftiger Modelle.

- Datenisolation: Gesundheitsdaten werden in einer separaten, verschlüsselten Umgebung gespeichert, getrennt von den üblichen Chatverläufen.

Mensch-in-the-Loop & Datenminimierung

Trotz strenger Richtlinien erfordert das digitale Zeitalter einen Ansatz der „Datenminimierung“.

- Sensible Informationen schwärzen: Beim Hochladen von Berichten sollten personenbezogene Daten (PII) wie Sozialversicherungsnummern, detaillierte Adressen oder Versicherungsnummern unkenntlich gemacht werden.

- Kritisches Denken: „Abnormale“ Warnmeldungen sollten als Anlass für eine professionelle Beratung und nicht als endgültige Urteile verstanden werden.

ChatGPT Health ermöglicht es uns, Körpersignale zu interpretieren und schließt damit eine wichtige Lücke im aktuellen Gesundheitssystem. Insbesondere in den USA, wo hohe Kosten, eingeschränkte Terminplanung und komplexe Versicherungssysteme die Behandlung oft verzögern, sind viele gezwungen, abzuwarten, bis sich ihr Zustand dramatisch verschlechtert, bevor sie Hilfe suchen.

ChatGPT Health revolutioniert dieses Paradigma. Es ermöglicht einen Wandel von reaktiver Behandlung hin zu proaktiver Prävention. Durch personalisierte Beratung zu Ernährung, Bewegung und Rehabilitation erhalten Nutzer professionelle Unterstützung, sobald ihr Körper signalisiert, dass er Hilfe benötigt.